Olhando diretamente para a câmera, a âncora de notícias fala da importância da cooperação entre os Estados Unidos e a China para apoiar a economia global.

À primeira vista, a mulher parece estar apresentando um noticiário regular. Mas, nem a locutora nem a marca Wolf News que aparecem no vídeo são reais. É uma falsificação profunda, gerada pela inteligência artificial (IA).

Os telespectadores que olham de perto podem ver alguns sinais de que algo está errado. A voz não soa natural e não se sincroniza com os movimentos da boca.

O vídeo é um dos dois que apareceram na mídia social em posts que pareciam promover os interesses do Partido Comunista Chinês (PCC), disse Graphika, uma empresa de investigação sediada em Nova York, em uma reportagem de fevereiro.

Os avanços com ferramentas generativas de IA despertaram preocupações sobre a capacidade da tecnologia de criar e disseminar desinformação em uma escala sem precedentes. Os apresentadores de notícias falsas alimentam essas preocupações.

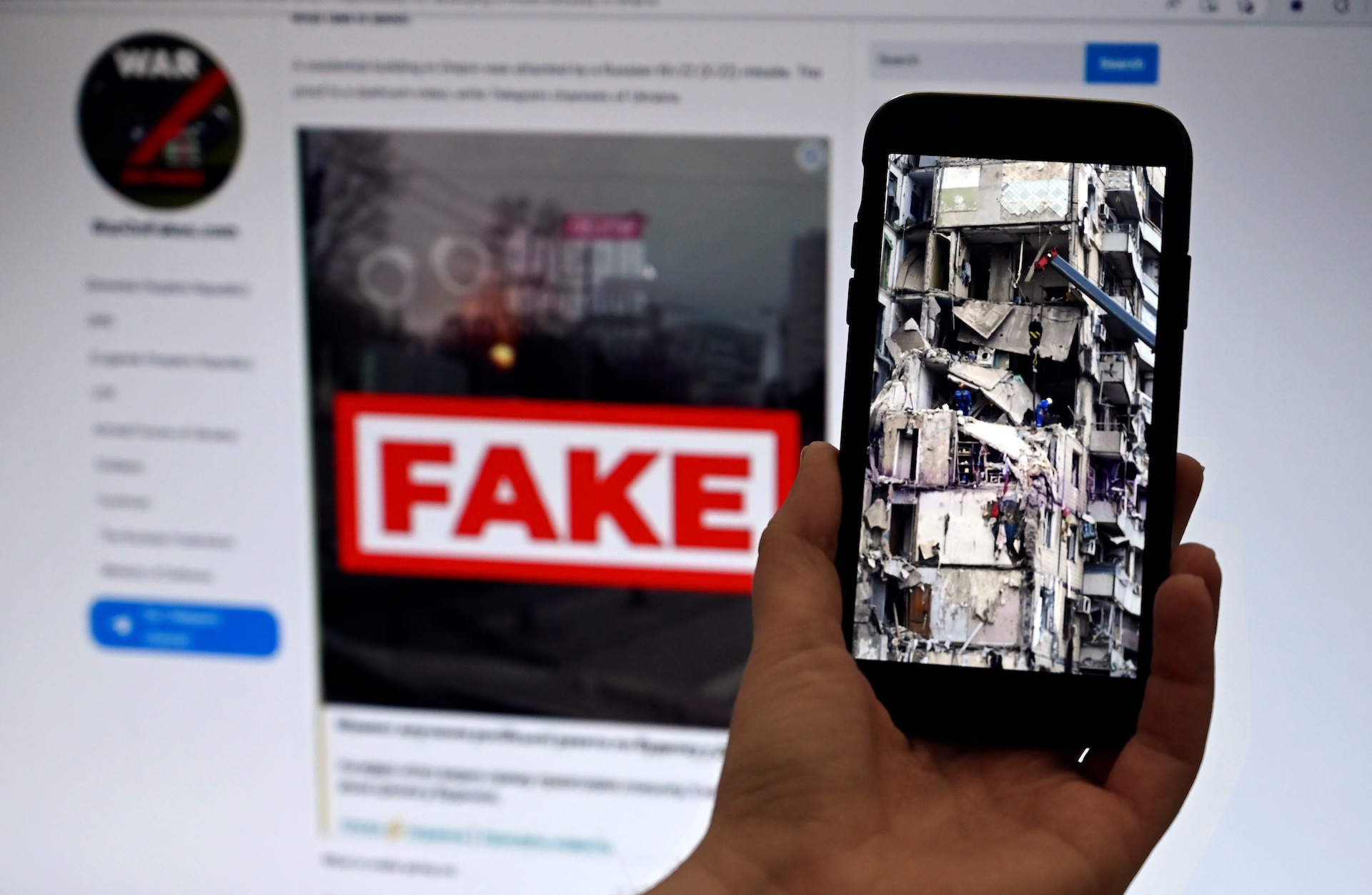

Esses avanços tecnológicos ocorrem quando um relatório de fevereiro da União Europeia descreve a abordagem multifacetada que a China e a Rússia estão adotando para tentar controlar as narrativas sobre tudo, desde a política externa até a guerra na Ucrânia.

O uso de apresentadores de notícias falsas não foi o aspecto mais surpreendente para Tyler Williams, diretor de investigações da Graphika. Em 2018, The Guardian relatou que a agência de notícias estatal chinesa Xinhua havia mostrado o primeiro apresentador de notícias de IA do mundo.

Williams também disse à VOA: “inicialmente ficamos surpresos de vê-lo dentro deste contexto”.

Graphika encontrou o apresentador de notícias ultra falsas em plataformas incluindo Facebook, Twitter e YouTube, enquanto monitorava as operações de desinformação pró-China que a empresa de pesquisa chamou de spamouflage.

Identificado pela primeira vez em 2019, o spamouflage refere-se a uma extensa rede de contas vinculadas a Pequim que divulgam propaganda pró-China.

“Há vários anos rastreamos esta campanha de spamouflage IO [operação de informação]”, disse Williams. “Esta é a primeira vez que vemos esta campanha usar este tipo de técnica ou tecnologia.”

Um porta-voz da Embaixada chinesa em Washington disse à VOA que o relatório Graphika “está cheio de preconceitos e especulações maliciosas às quais a China se opõe firmemente”.

“Nos últimos anos, alguns meios de comunicação e think tanks ocidentais caluniaram o uso da China de falsas contas da mídia social, para divulgar as chamadas informações ‘pró-China’”, disse o porta-voz via e-mail. “A China acredita que todos os usuários da mídia social têm o direito de expressar sua própria voz.”

No entanto, vários órgãos documentaram como a China censura as mídias sociais e até mesmo prende os usuários que criticam o governo.

Erosão da confiança

A habilidade e eficiência com as quais a IA pode gerar desinformação é particularmente preocupante para Williams.

“A maior preocupação é a contínua erosão da confiança, quer se trate de mídias de notícias, ou de notícias publicadas em plataformas de mídia social. Esse nível de autenticidade está cada vez mais em discussão, à medida que vemos essa escala aumentar, o que supomos que ocorrerá”, afirmou. “Para mim, essa é a principal preocupação. Será que acabaremos neste ambiente final, de confiança zero, cínico, onde tudo é falso?”

“Esse é um tipo de cenário apocalíptico”, acrescentou Williams rapidamente. Estes desenvolvimentos ainda não devem ser exagerados, advertiu.

Atualmente, a tecnologia está longe de estar aperfeiçoada, de acordo com Bill Drexel, que pesquisa inteligência artificial no think tank Center for a New American Security, em Washington.

“Quando vi os vídeos inicialmente, pensei que eram quase engraçados, porque eles não combinavam com uma falsificação profunda particularmente de alta qualidade”, disse à VOA. “Mas é uma espécie de presságio sombrio do que está por vir, no que se refere à desinformação no exterior”.

“A China é meio infame por sua desinformação estrangeira ser surda e muitas vezes contraproducente”, disse Drexel.

Mas a China não está sozinha no uso da tecnologia para desinformação.

O relatório do Serviço de Ação Externa da União Europeia (UE) concentrou-se na desinformação russa e chinesa e descobriu que Moscou estava apoiando operações de desinformação que personificam os meios de comunicação internacionais.

O estudo analisou uma amostra de 100 casos do que ele denomina “manipulação de informação”, entre outubro e dezembro. Com 60 exemplos ligados à invasão russa da Ucrânia, o objetivo de Moscou é distrair o público, desviar a culpa ou direcionar a atenção para diferentes tópicos, segundo o relatório.

“Esta guerra não é conduzida apenas no campo de batalha pelos soldados, mas ela é travada também no espaço da informação, tentando conquistar os corações e as mentes do povo”, disse o chefe de Política Externa da UE, Josep Borrell, em um discurso em fevereiro. “Temos muitas provas de que a Rússia está por trás de tentativas coordenadas de manipular os debates públicos em sociedades abertas.”

A mídia impressa e televisiva são os alvos mais frequentes da falsificação de identidade de Moscou, em particular quando se trata da Ucrânia.

O relatório citou quatro casos em que foram criadas falsas páginas de capa, imitando revistas satíricas europeias, para atacar a Ucrânia e o presidente Volodymyr Zelenskyy.

“Ninguém está isento de ver sua identidade ou marca ser mal utilizada”, afirmou o relatório. “Os atores de ameaças usam a representação para acrescentar legitimidade às suas mensagens e para alcançar e afetar o público familiarizado e confiante nas entidades personificadas.”

A Embaixada da Rússia em Washington não respondeu ao e-mail da VOA solicitando comentários.

A estratégia de falsificação é rudimentar, mas a desinformação não precisa ser sofisticada para ser eficaz, disse Nika Aleksejeva, que investiga a desinformação russa no Laboratório de Investigação Forense Digital do Conselho do Atlântico.

Às vezes, o básico funciona melhor, disse. Atribuir coisas falsas aos veículos de mídia torna as mentiras mais plausíveis. O objetivo é fazer com que os leitores pensem: “Se este meio de comunicação legítimo escreveu sobre isso, então deve ser verdade”, disse Aleksejeva.

Esta estratégia é particularmente eficaz porque quando os leitores clicam nas páginas falsas, eles serão levados de volta ao verdadeiro site de notícias, de acordo com Aleksejeva.

“É preciso mais vigilância de um leitor para realmente perceber que algo está errado”, disse Aleksejeva à VOA da capital da Letônia, Riga.

Aleksejeva também está preocupada sobre como a IA generativa poderia ser usada para potencializar as campanhas de desinformação. Agora, disse ela, é tão fácil quanto alimentar uma ferramenta de IA com alguns detalhes e pedir uma história.

“O volume vai mudar definitivamente”, declarou. “É muito mais fácil inventar uma história.”